像素级优化技术在人工智能(AI)中扮演着至关重要的角色,尤其是在图像处理、视频分析以及计算机视觉领域。这些技术使得AI系统能够更加精确地识别和处理图像中的细节信息,从而提供更高质量的结果。以下是一些创新的突破点,旨在实现像素级优化技术:

1. 深度学习与神经网络架构的创新:传统的神经网络模型可能在处理大型数据集时遇到性能瓶颈。通过采用新的网络架构,如卷积神经网络(CNN)、递归神经网络(RNN)或变分自编码器(VAE),可以显著提高模型的效率和性能。例如,使用注意力机制的网络可以在保持高准确率的同时减少计算量。

2. 硬件加速:随着GPU和TPU等专用硬件的发展,AI模型的训练和推理速度得到了极大的提高。通过利用硬件加速,可以在不影响性能的情况下大幅度提高处理速度。例如,NVIDIA的A100 GPU提供了比传统GPU高出近33倍的浮点运算能力,这为处理复杂的像素级图像数据提供了可能。

3. 分布式计算:随着数据量的增加,传统的单机计算方法已经无法满足需求。通过分布式计算,可以将任务分配给多个处理器共同完成,从而提高整体的处理能力。例如,使用Spark或Hadoop等大数据处理框架,可以在多台机器上并行处理图像数据,加快处理速度。

4. 优化算法:针对特定类型的图像数据,开发高效的优化算法是实现像素级优化的关键。例如,对于人脸检测任务,可以通过改进特征提取方法(如深度特征金字塔网络DFPN)来提高检测精度和速度。对于医学图像分析,可以通过优化卷积操作和损失函数来提高分类和分割的准确性。

5. 量化技术:为了降低模型的大小和计算复杂度,可以使用量化技术将浮点数转换为整数。这种方法可以减少内存占用和计算时间,同时也能保持较高的精度。例如,使用量化后的神经网络可以有效地处理大规模图像数据。

6. 元学习:元学习是一种机器学习技术,它允许模型从大量实例中学习并自动调整其参数以适应新的输入数据。通过元学习,可以不断优化像素级优化技术,使其适应不断变化的数据环境。

7. 迁移学习:迁移学习是一种利用预训练模型来提高新任务性能的技术。通过迁移学习,可以将在特定任务上表现良好的模型作为起点,然后对其进行微调以适应新的像素级优化任务。这种方法可以节省大量的训练时间和资源。

8. 自适应网络结构:根据不同的应用场景和数据特性,可以动态调整网络的结构。例如,对于边缘检测任务,可以使用较小的卷积核来捕获更多的边缘信息;而对于人脸识别任务,可以使用较大的卷积核来提取更多的特征。

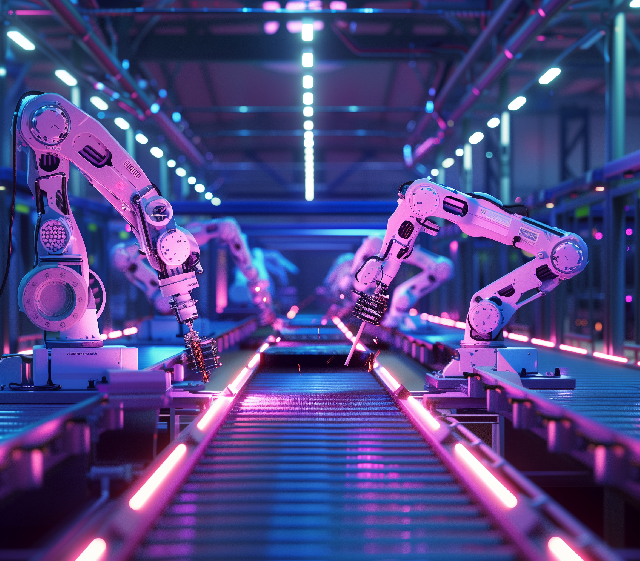

9. 实时处理技术:对于需要实时处理的应用,如自动驾驶或工业检测,需要开发低延迟、高性能的像素级优化技术。通过优化数据处理流程和算法,可以提高系统的响应速度和准确性。

10. 跨域迁移学习:跨域迁移学习是一种将不同领域的知识应用于同一任务的技术。通过在不同领域之间进行迁移学习,可以充分利用各种领域的经验和知识,从而提高像素级优化技术的性能。

总之,实现像素级优化技术的创新突破需要综合考虑多种因素,包括网络架构、硬件加速、算法优化、量化技术、元学习和迁移学习等。通过不断的探索和实践,我们可以不断提高AI系统的性能和效率,为各行各业带来更多的可能性。