随着人工智能技术的飞速发展,大模型的普及已经成为了不可逆转的趋势。然而,这种趋势也带来了一系列潜在的风险和挑战。以下是一些可能的风险:

1. 数据隐私和安全问题:大模型的训练需要大量的数据,而这些数据往往涉及到用户的个人信息。如果这些数据被滥用或者泄露,可能会导致用户隐私受到侵犯,甚至引发更严重的网络安全问题。

2. 算法偏见和歧视:大模型通常基于大规模的数据集进行训练,这可能导致算法存在偏见和歧视。例如,如果一个模型在训练过程中只使用了少数群体的数据,那么它可能会对少数群体产生不公平的判断。此外,如果模型在处理不同文化、语言或背景的数据时出现偏差,那么它可能会对特定群体产生负面影响。

3. 可解释性和透明度:大模型的复杂性使得它们难以理解和解释。这可能导致用户对模型的决策过程感到困惑,甚至质疑其公正性和可靠性。为了提高模型的可解释性,研究人员需要开发新的技术和方法,以便更好地理解模型的工作原理。

4. 资源消耗和环境影响:大模型的训练需要大量的计算资源,这可能导致能源消耗增加,甚至引发环境问题。此外,模型的部署和维护也需要相应的硬件和软件支持,这也可能带来额外的成本。

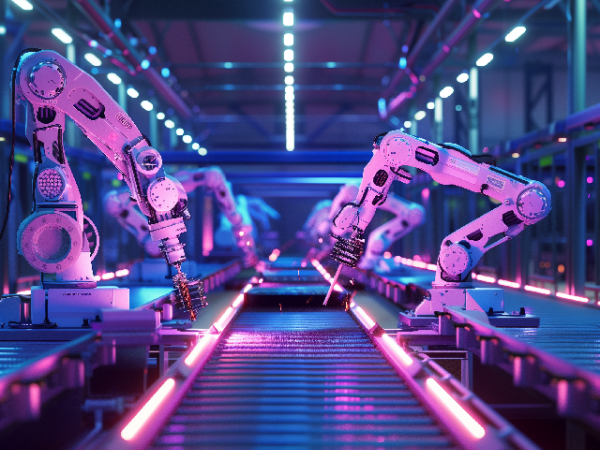

5. 失业和职业转型:随着大模型的普及,许多传统行业可能会受到影响,导致失业问题。同时,这也为新兴行业提供了机会,促使人们进行职业转型。然而,这也可能引发社会不稳定和就业压力。

6. 伦理和道德问题:大模型的普及可能会引发一系列伦理和道德问题。例如,如果模型在处理涉及人类生命、财产等重要问题时出现错误,那么它可能会引发法律责任和道德争议。此外,如果模型在决策过程中受到外部因素的影响,那么它可能会被视为一种“黑箱”系统,从而引发公众对人工智能的信任危机。

7. 技术失控和安全风险:随着大模型的普及,可能会出现技术失控的情况。例如,如果模型被黑客攻击或者被恶意利用,那么它可能会对整个网络系统造成严重威胁。此外,大模型还可能成为黑客攻击的目标,因为其庞大的计算能力使得攻击者能够轻松地获取并利用模型的敏感信息。

8. 法律和监管挑战:随着大模型的普及,各国政府和国际组织需要制定相应的法律法规来规范其发展和应用。然而,目前尚无统一的标准和规范可供参考,这可能导致法律和监管方面的挑战。此外,随着大模型在各个领域的应用越来越广泛,如何确保其符合当地的法律法规也成为了一个亟待解决的问题。

总之,大模型的普及虽然带来了许多便利和创新,但同时也伴随着一系列风险和挑战。因此,我们需要密切关注这些问题,并采取相应的措施来应对它们。