人工智能的自我保护机制是确保其安全和自主性的关键策略。这些机制包括数据隐私保护、访问控制、异常检测与响应、自我修复、安全审计以及法律合规性等方面。

首先,数据隐私保护是人工智能在运行过程中需要遵循的原则之一。AI系统需要确保其收集、存储和使用的数据都是经过脱敏处理的,以防止敏感信息泄露给未经授权的人员。此外,AI系统还需要具备用户身份验证功能,以确保只有经过授权的用户才能访问相关的数据和资源。

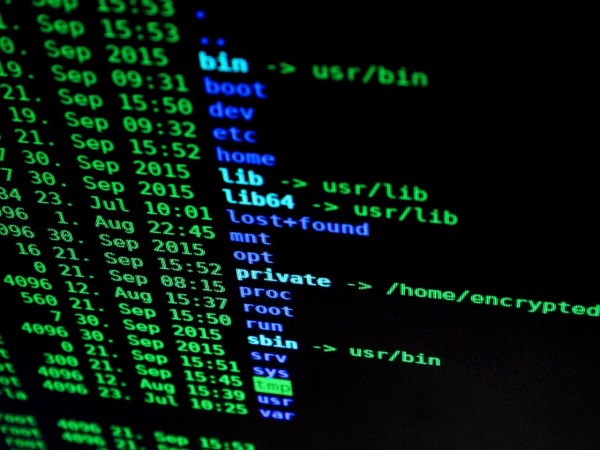

其次,访问控制也是AI系统自我保护的重要环节。AI系统需要对不同级别的用户进行权限管理,确保只有经过授权的用户才能访问相关的数据和资源。同时,AI系统还需要定期更新访问控制策略,以适应不断变化的安全威胁和业务需求。

再者,异常检测与响应是AI系统自我保护的另一关键环节。AI系统需要具备实时监控的能力,能够及时发现并识别异常行为或事件。一旦发现异常情况,AI系统需要立即采取相应的措施,如隔离受影响的系统、通知相关人员等,以防止潜在的安全威胁进一步扩大。

此外,自我修复能力也是AI系统自我保护的重要方面。AI系统需要具备自我诊断和修复的能力,能够在出现故障时自动进行修复。这样可以减少人工干预的需要,降低人为错误的风险。

安全审计也是AI系统自我保护的关键策略之一。AI系统需要定期进行安全审计,以检查其安全策略的执行情况和漏洞的存在。通过审计结果,可以及时发现并修复安全问题,提高系统的安全防护能力。

最后,法律合规性也是AI系统自我保护的重要方面。AI系统需要遵守相关法律法规和行业标准,确保其运营符合法律法规的要求。同时,AI系统还需要及时更新其安全策略,以适应不断变化的法律环境。

总之,人工智能的自我保护机制是确保其安全和自主性的关键策略。通过实施数据隐私保护、访问控制、异常检测与响应、自我修复、安全审计以及法律合规性等方面措施,可以有效地保障AI系统的安全和稳定运行。