大数据技术的核心在于存储和处理海量、多样的数据,以支持实时分析、决策制定和业务洞察。随着数据量的急剧增加,传统的数据处理方法已不再适用,因此需要创新的大数据存储与计算模式来应对挑战。以下是几种主要的大数据存储与计算模式:

1. 分布式存储系统(Distributed Storage Systems)

分布式存储系统通过将数据分散到多个服务器上,实现了数据的高可用性和容错性。典型的分布式存储系统有Hadoop HDFS(Hadoop Distributed File System)、Ceph、GlusterFS等。这些系统通常采用复制策略(如Raft或Paxos)来保证数据在节点间同步和一致性。

2. 边缘计算(Edge Computing)

边缘计算是一种将数据处理任务从中心数据中心转移到离数据源更近的位置的技术。这可以减少延迟,提高响应速度,并减轻中心数据中心的压力。边缘计算适用于实时数据分析、视频监控、自动驾驶车辆等领域。

3. 云计算(Cloud Computing)

云计算提供了弹性的计算资源和服务,使得企业可以按需获取计算能力。云平台如Amazon AWS、Google Cloud、Microsoft Azure等提供包括大数据存储在内的多种服务。通过云平台,企业可以实现数据的快速访问、成本控制以及资源的动态调整。

4. 分布式数据库(Distributed Databases)

分布式数据库允许数据被分布在多个机器上,从而提供更好的扩展性和性能。例如,Apache Cassandra是一个开源的分布式NoSQL数据库,它支持高可用性、高性能和可伸缩性。

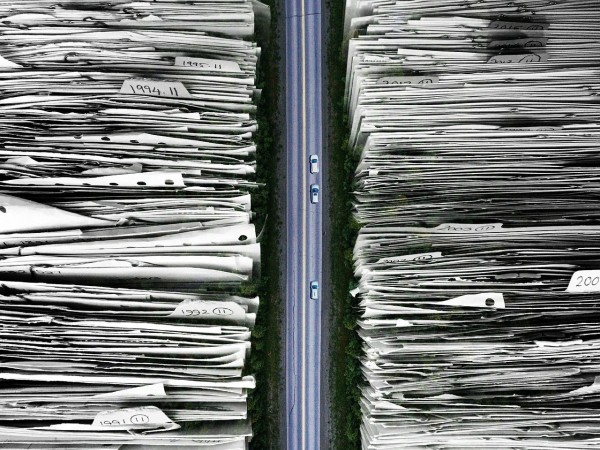

5. 数据湖(Data Lakes)

数据湖是一个巨大的存储空间,用于存储原始数据,不进行任何形式的过滤或格式化。这使得数据湖非常适合于处理结构化和非结构化数据。数据湖通常包含来自各种来源的数据,并且可以与数据仓库和数据管道集成使用。

6. 流处理(Stream Processing)

流处理关注在数据流上的实时分析,它允许对连续产生的数据流进行即时处理。这种处理方式对于金融交易、社交媒体分析、物联网(IoT)设备生成的数据等场景至关重要。流处理框架如Apache Kafka、Storm和Flink等为这类应用提供了高效的数据处理能力。

7. Hadoop生态系统中的其他组件

除了HDFS,Hadoop生态系统还包括MapReduce、Pig、Hive等工具,它们共同构成了一个强大的大数据处理和分析平台。Hadoop的YARN(Yet Another Resource Negotiator)负责管理集群资源,而HBase则是一个基于磁盘的NoSQL数据库,专门用于存储大量非结构化数据。

8. 机器学习与人工智能(Machine Learning and AI)

大数据不仅仅是存储数据,更重要的是如何从中提取有用的信息和知识。机器学习和人工智能技术能够从数据中学习模式,预测未来趋势,从而为企业决策提供支持。这些技术通常需要大量的数据输入,因此它们的实现往往依赖于高效的大数据存储和计算模式。

9. 数据治理(Data Governance)

随着数据量的激增,数据治理变得越来越重要,以确保数据的准确性、完整性和安全性。良好的数据治理包括数据质量管理、元数据管理、数据权限管理等方面。

总之,未来的大数据存储与计算模式将继续朝着更加高效、智能和灵活的方向发展。结合云计算、边缘计算、分布式数据库、流处理等技术的融合将是大势所趋。同时,随着人工智能和机器学习技术的发展,它们将在大数据分析中扮演越来越重要的角色,推动大数据产业不断创新和发展。